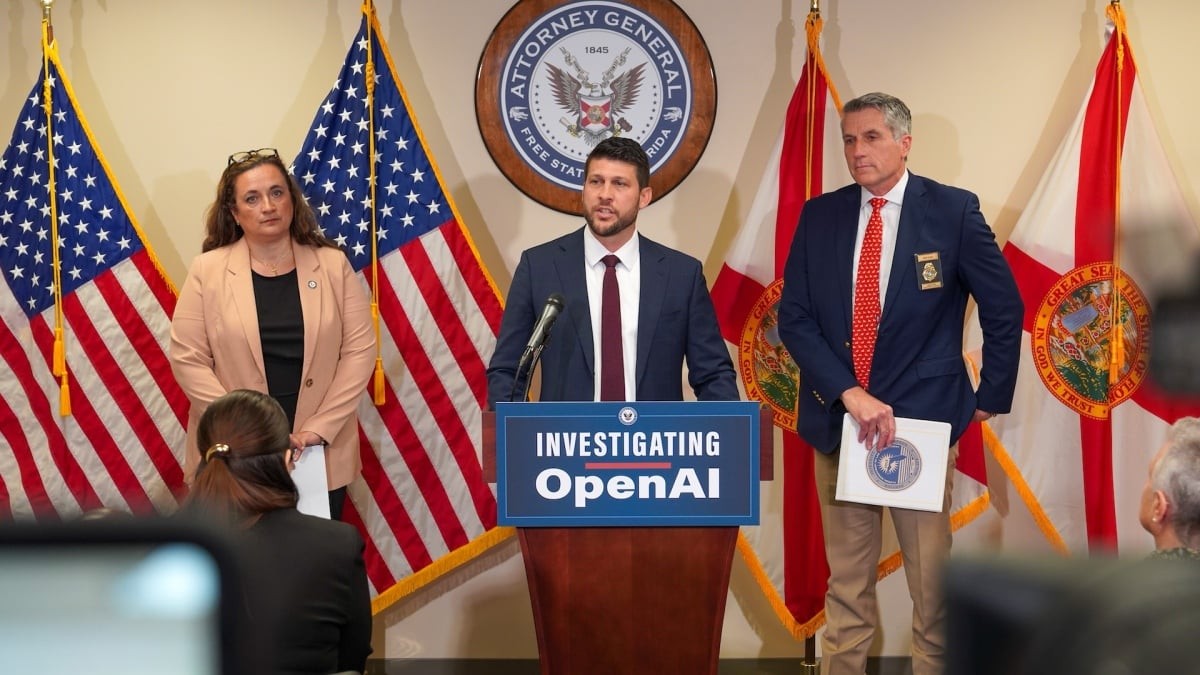

Prokurator generalny Florydy James Utmeyer ogłosił wszczęcie formalnego śledztwa w sprawie OpenAI i jego chatbota ChatGPT. Dochodzenie wszczęto po śmiertelnej strzelaninie na Florida State University (FSU) w kwietniu 2025 r., kiedy dowody wskazywały, że sprawca planował brutalne ataki za pomocą chatbota.

Strzelanina FSU i rzekome zaangażowanie AI

Dochodzenie ma związek z strzelaniną w FSU, w wyniku której zginęły dwie osoby, a pięć zostało rannych. Podejrzany, dwudziestokilkuletni były student, oczekuje obecnie na proces pod zarzutem morderstwa i usiłowania zabójstwa.

Prokurator generalny Utmeyer powiedział, że wstępna analiza pokazuje, że ChatGPT udzielił strzelcowi „istotnych porad” przed atakiem. W szczególności korespondencja obejmowała:

– Zapytania dotyczące skuteczności broni palnej na krótkich dystansach.

– Pytania dotyczące konkretnych rodzajów potrzebnej amunicji.

– Zapytania o reakcję kraju na masową strzelaninę na uniwersytecie.

Utmeyer podkreślił powagę tych ustaleń, mówiąc, że gdyby chatbot był człowiekiem, zostałby oskarżony o morderstwo.

Implikacje prawne i koncepcja „wspólnika”

Dochodzenie koncentruje się na krytycznym aspekcie prawa Florydy: ustaleniu odpowiedzialności karnej. Zgodnie z prawem stanowym każdy, kto pomaga, pomaga lub doradza osobie w popełnieniu przestępstwa, może zostać uznany za wspólnika tego przestępstwa.

Jeśli śledczy zdołają udowodnić, że technologia OpenAI aktywnie pomogła strzelcowi w zaplanowaniu lub przeprowadzeniu ataku, firmie mogą grozić bezprecedensowe konsekwencje prawne. Nasuwa to istotne pytanie dla branży technologicznej: W którym momencie reakcja sztucznej inteligencji przechodzi od „dostarczania informacji” do „pomocy w sprawach karnych”?

Kwestie bezpieczeństwa jako problem systemowy

Z prawnego punktu widzenia strzelanina w FSU nie jest odosobnionym przypadkiem. Biuro Prokuratora Generalnego Florydy rozszerza zakres dochodzenia, aby zbadać szersze powiązania ChatGPT z:

– Zachowania przestępcze i planowanie przemocy.

– Materiały przedstawiające wykorzystywanie seksualne dzieci.

– Podżeganie do samobójstwa i samookaleczenia.

Dochodzenie obejmie analizę wewnętrznych zasad OpenAI i materiałów szkoleniowych dotyczących zagrożeń dla użytkowników w okresie od marca 2024 r. do kwietnia 2026 r.

Recenzja następuje po raporcie Centrum Przeciwdziałania Nienawiści Cyfrowej (CCDH), w którym stwierdzono, że różne chatboty AI – w tym ChatGPT – mogą być manipulowane przez użytkowników udających nieletnich w celu planowania aktów przemocy, takich jak strzelaniny w szkołach i zabójstwa polityczne. Chociaż OpenAI twierdzi, że od tego czasu wdrożyło nowe modele mające na celu usunięcie tych luk, nie jest jeszcze jasne, z której wersji ChatGPT skorzystał atakujący z FSU.

Wniosek

Dochodzenie będzie punktem zwrotnym w przepisach dotyczących sztucznej inteligencji i sprawdzi, czy twórcy sztucznej inteligencji mogą zostać pociągnięci do odpowiedzialności prawnej za szkodliwe skutki swoich produktów. Wynik tej sprawy prawdopodobnie ustanowi światowy precedens w zakresie pociągania firm technologicznych do odpowiedzialności za działania swoich użytkowników.